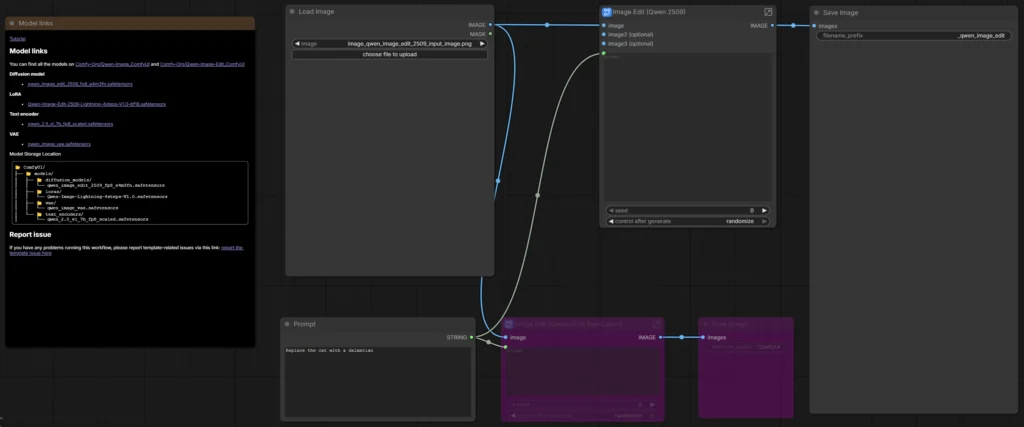

C’è un momento in cui ti accorgi che la parte difficile non è ottenere un’immagine bella, il difficile è ottenere la stessa immagine, ma con una modifica precisa mantenendo tutto il resto intatto. È qui che entrano in gioco i workflow di image editing guidati da istruzioni, ecco a voi un flusso che vi trasforma da “prompt artist” a “image editor” dentro ComfyUI.

Molti approcci generativi partono dal rumore e costruiscono un’immagine da zero. Qui la sensazione è diversa perché il punto di partenza è già un’immagine completa. Il modello viene chiamato a fare un’operazione mirata, come se avessi un assistente che prende il file, ascolta la richiesta e ritocca dove serve, provando a non rovinare ciò che già funziona.

Load Image

Il nodo “Load Image” è il tuo input reale. Qui non stai caricando una reference per ispirare lo stile (come faresti in certe pipeline), stai caricando il materiale di lavoro. L’output IMAGE va diretto nel nodo di editing, quindi quel file è l’ancora di tutto il processo.

Un dettaglio spesso ignorato: la qualità della sorgente condiziona la qualità della modifica. Se l’immagine è compressa, piena di artefatti o ha dettagli confusi, il modello avrà più difficoltà a “capire” cosa preservare e dove intervenire. Al contrario, un’immagine pulita rende più facile fare edit credibili e locali.

Prompt

Il nodo “Prompt” in questo workflow non è un “prompt da generazione classica” (quelli lunghi con stile, lente, illuminazione, mille aggettivi). Qui il prompt funziona meglio quando è una richiesta operativa.

È utile pensarlo come un brief di ritocco: “Sostituisci X con Y”, “Rimuovi Z”, “Cambia il colore di…”, “Aggiungi… mantenendo…” e via così. Se vuoi che il modello rispetti il contesto, conviene specificarlo in modo diretto, perché quello è il vero rischio di ogni image edit: che per cambiare una cosa ti cambi anche il resto.

Quando vuoi un risultato controllato, la struttura mentale più utile è: azione + soggetto + vincoli di preservazione. L’azione è il verbo (replace, remove, add, change). Il soggetto è cosa tocchi. I vincoli sono ciò che deve restare identico (background, lighting, perspective, composition, style, shadows). Segue una tabella esplicativa.

| Azione (verbo) | Soggetto (cosa tocchi) | Vincoli di preservazione (cosa resta identico) | Prompt esempio (EN) |

|---|---|---|---|

| Replace | il gatto | stessa posa, stessa inquadratura, stesso sfondo, stessa luce, ombre coerenti | “Replace the cat with a dalmatian, keep the same pose, background, lighting, framing, and shadows.” |

| Remove | persone sullo sfondo | mantieni soggetto principale, prospettiva, esposizione, grana/stile, nessun cambiamento alla scena | “Remove the people in the background, keep the main subject unchanged, same perspective, lighting, and style.” |

| Add | un poster sul muro | mantieni texture del muro, illuminazione, prospettiva, tono colore della stanza | “Add a vintage poster on the wall, match the room perspective and lighting, keep the wall texture and overall color tone.” |

| Change | colore della giacca | mantieni volto, pelle, capelli, pieghe del tessuto, luce e ombre originali | “Change the jacket color to dark green, keep the person’s face, hair, fabric folds, lighting and shadows the same.” |

| Replace | cielo | mantieni edifici, linee verticali, esposizione, temperatura colore, riflessi coerenti sui vetri | “Replace the sky with a dramatic sunset, keep the buildings unchanged, preserve straight verticals, exposure, color temperature, and realistic reflections.” |

Image Edit Qwen

Il nodo “Image Edit (Qwen 2509)” è il cuore del workflow. È lui che riceve l’immagine e la stringa, e produce un’immagine modificata. Nel tuo screenshot si vedono tre ingressi: image, image2 (optional), image3 (optional). Oltre all’immagine principale, puoi dare una o due immagini aggiuntive come supporto (per guidare un soggetto, un pattern, un riferimento visivo).

Nel nodo c’è anche il parametro seed e l’opzione “control after generate: randomize”. Anche qui vale una regola da produzione, se stai cercando una singola soluzione “buona”, randomizzare ti aiuta a esplorare. Se invece stai rifinendo un risultato e vuoi capire l’effetto di micro-cambi nel prompt, tieni fermo il seed. In un workflow di editing, il seed diventa un modo per mantenere stabilità mentre aggiusti la richiesta.

Errori comuni

L’errore più comune è chiedere un edit troppo grande senza dire cosa preservare. Il modello allora fa quello che sa fare: ricostruisce la scena in modo coerente con la richiesta, ma non necessariamente coerente con la tua immagine originale.

Il secondo errore è l’ambiguità. Se dici “replace the cat”, ma nell’immagine ci sono due animali o un peluche che assomiglia a un gatto, il modello sceglie. Se vuoi controllo, chiarisci la posizione: “replace the cat sitting on the left”. In editing, la spazialità è una parola magica.

Il terzo è la coerenza di scala. Se sostituisci un oggetto con qualcosa di molto diverso per dimensione, il modello deve “inventare” come farlo stare dentro la scena, e questa invenzione spesso contagia anche luci e prospettiva. Se vuoi un edit chirurgico, scegli sostituzioni plausibili o specifica esplicitamente “same size and position”.

Nodi Muted

Nello screenshot i blocchi viola sono nodi che ComfyUI sta trattando come “muted / disattivati” (in pratica una branch alternativa lasciata lì, ma che non viene eseguita nel run corrente).

In questo workflow, infatti, la pipeline che sta davvero lavorando è: Load Image → Image Edit (Qwen 2509) → Save Image (in alto). Quella in viola in basso è una copia/variante (spesso “Raw/Linear” o preset alternativo) tenuta come riferimento o opzione rapida.

Smanettiamo

Ah, ora si smanetta sul serio su ComfyUI. Spero che tutta quella teoria non ti abbia steso, è il passaggio obbligato per avere controllo invece di procedere a tentoni. Come diceva uno spot anni ’90 “la potenza è nulla senza controllo”, tra un attimo capirai esattamente cosa stai facendo mentre giri le manopole. Andiamo, che qui inizia a vedersi la differenza.

Change the race of the woman, from asian to afro.

Change the image style, from sketch to realistic cinematic style.

Color the sketch with vivid watercolors, joy.

Una volta capito il meccanismo, i risultati diventano davvero notevoli.

Se l’articolo ti è piaciuto restiamo in contatto su linkedin a: https://www.linkedin.com/in/andreatonin/

ComfyUI #QwenImageEdit #ImageEditing #InstructionPrompting #SeedControl #WorkflowDesign #ModelLinks #Iteration #NonDestructiveEdit #PromptConstraints

Nerd per passione e per professione da oltre 30 anni, lavoro nel mondo dell’innovazione tecnologica come CTO e consulente, progettando ecosistemi software complessi e scalabili. Parallelamente mi dedico alla formazione informatica, condividendo esperienze e buone pratiche maturate sul campo.

Scopri di più sulla mia attività di consulenza su lucedigitale.com Mi trovi anche su LinkedIn