È stata una settimana intensa, di quelle che ti lasciano addosso la voce un po’ consumata e la testa ancora accesa. Mi sono ritrovato a fare da relatore in una serie di speech pubblici, e il tema tornava sempre lì… l’intelligenza artificiale, il suo impatto sulla società e sul lavoro. Nel giro di pochi giorni ho incrociato centinaia di sguardi molto diversi (ragazzi appena diplomati, manager navigati, imprenditori con anni sulle spalle) e tutti seguivano la mia arringa oscillando tra curiosità e apprensione.

A un certo punto, mentre parlavo, ho iniziato a guardare davvero quegli occhi. E mi è venuta una domanda che non mi ha più lasciato: perché questo software vi dà così fastidio? Perché vi turba più di qualsiasi altra tecnologia? In fondo anche una suite Office, un gestionale di magazzino o persino un muletto che sposta pallet hanno cambiato mansioni, creato scosse, ridisegnato ruoli. Hanno tolto pezzi di lavoro e ne hanno creati altri. Eppure non hanno mai suscitato lo stesso tipo di inquietudine, quella paura sottile che non riguarda solo lo stipendio, ma qualcosa di più personale.

Da qui parte la mia riflessione.

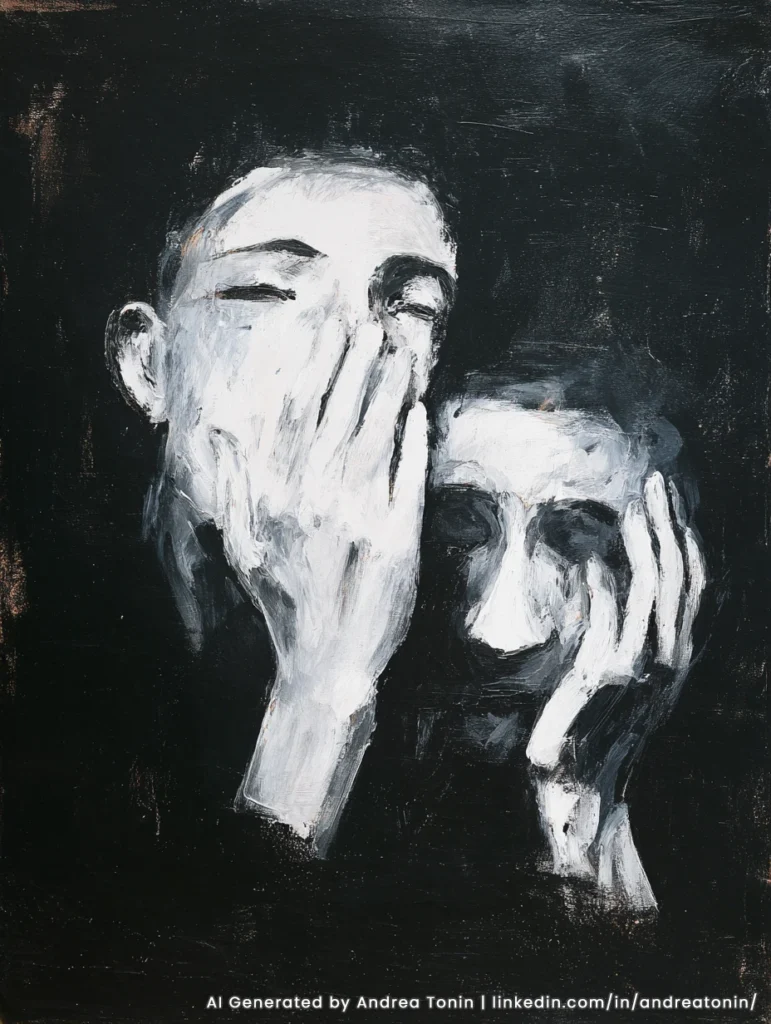

Prima ancora di essere un oggetto tecnico, l’intelligenza artificiale è diventata una piccola ferita simbolica. Non nel senso melodrammatico del termine, ma in quello più preciso di qualcosa che incrina un’immagine di noi stessi a cui eravamo abituati. Non perché una macchina “sia viva”, o “sia cosciente”, ma perché tocca il territorio in cui l’umano si è sempre sentito unico… la sua intelligenza, unica vera differenza che lo rende superiore (a suo pensare) alle altre forme di vita del pianeta. Ora… l’intelligenza umana viene messa in discussione dall’enorme potenza di calcolo della AI, in tutte le sue forme migliori come la competenza del linguaggio, l’invenzione di forme, la capacità di prevedere, di comporre, di rispondere.

Da qui nasce un disagio che non è soltanto economico o tecnologico. È una reazione emotiva e culturale, la sensazione che qualcosa stia bussando alla porta del primato umano. È anche per questo che certe frasi diventano slogan. Servono a difendere, a sminuire, a rimettere in ordine una gerarchia che appare minacciata.

La AI è solo statistica

C’è una frase che torna spesso, come un colpo secco sul tavolo: “L’intelligenza artificiale è solo statistica”. La si sente nei dibattiti pubblici, nei commenti sotto gli articoli, a volte anche in contesti accademici. Ha l’apparenza della precisione, e per questo è seducente perché sembra tagliare via le esagerazioni, rimettere ordine, riportare la discussione alla tecnica. Eppure, proprio perché è “vera” in un senso minimale, rischia di essere una verità povera.

Dire “solo statistica” può essere un modo elegante per non vedere che cosa l’AI diventa quando esce dal laboratorio ed entra nella società. E oggi ci entra in modo capillare, spesso in modo del tutto invisibile. La ritroviamo nei motori di raccomandazione che modellano gusti e attenzione, nelle procedure di selezione del personale, nei sistemi di traduzione che cambiano il rapporto tra lingue, nelle piattaforme educative, nella scrittura, nella diagnosi, nella sicurezza, nella giustizia amministrativa. Il punto decisivo non è negare la dimensione matematica (che è reale), ma capire perché quella dimensione, da sola, non esaurisce l’oggetto. Le tecnologie non sono mai soltanto ciò che sono “sotto il cofano”, sono anche ciò che fanno alle forme di vita.

Una lettera d’amore è solo cellulosa e inchiostro

L’equivoco ricorrente è di pensare che descrivere il meccanismo equivalga a chiudere la questione del significato. Una lettera d’amore, in fondo, è cellulosa e inchiostro; una sinfonia è vibrazione dell’aria; un tribunale è un edificio con pratiche burocratiche; un corpo umano è materia organizzata. Ma nessuna di queste definizioni è sufficiente quando vogliamo capire come agiscono nel mondo umano. Il problema non è la correttezza tecnica, è l’idea che la correttezza tecnica basti.

L’intelligenza artificiale contemporanea (in particolare i modelli addestrati su grandi quantità di dati) ha una natura che possiamo descrivere in termini statistici, infatti apprende regolarità, stima probabilità, genera output plausibili. Questa descrizione è utile, spesso necessaria, e può anche essere salutare quando serve a smontare fantasie animistiche. Nel momento in cui la statistica si traduce in testo, decisioni, raccomandazioni, immagini, filtri e priorità, entra nel territorio delle norme, ne deriva la definizione di che cosa è accettabile, che cosa è giusto, che cosa conta come vero, chi ha accesso a che cosa, chi paga il prezzo dell’errore, chi si assume la responsabilità.

Gelosia, riduzionismo e incantamento

Il punto più sensibile è antropologico. L’uomo moderno ha costruito molta della propria autocomprensione attorno all’idea della centralità dell’intelligenza come marchio distintivo. Non siamo i più forti, non siamo i più veloci, non siamo i più resistenti ma sappiamo parlare, simbolizzare, progettare, inventare strumenti. Da questa capacità deriva una parte enorme del nostro potere sul mondo, ma anche del nostro senso di eccezionalità. Quando una macchina produce testi convincenti, traduce, sintetizza, programma, “dialoga” in modo credibile, tocca proprio quel nervo. Per questo l’AI non è percepita come una semplice tecnologia tra le altre, ma mette in gioco un tratto identitario.

È qui che nasce una strana inquietudine. È una specie di gelosia di specie, un sentimento che non sempre ammettiamo perché suona infantile, ma che si muove sotto la superficie. L’idea che un artefatto (neppure a base di carbonio) possa occupare lo spazio dell’intelligenza (o di qualcosa che le somiglia) sembra sfiorare un tabù, la sensazione di essere superati da ciò che abbiamo costruito.

Questa gelosia porta a due reazioni opposte, entrambe comode. La prima è il riduzionismo: “non è nulla, è solo statistica”. Così si evita il confronto con la ferita simbolica. Se non è “vera” intelligenza, allora l’umano resta salvo. La seconda è l’incantamento: “sta nascendo una nuova mente, inevitabilmente superiore”. Anche qui c’è una scorciatoia, perché trasforma una costruzione socio-tecnica in un destino, e toglie all’umano il peso della responsabilità. In entrambi i casi, si cerca di scappare dalla zona grigia, che è la zona più reale in cui l’AI è abbastanza potente da cambiare pratiche e istituzioni, ma abbastanza dipendente da scelte umane da non poter essere considerata un agente autonomo nel senso pieno.

Un umanesimo fragile?

Se l’umanesimo (https://it.wikipedia.org/wiki/Umanesimo) si regge su una classifica (noi valiamo perché siamo primi), allora è fragilissimo. Basta che qualcun altro, o qualcos’altro, sembri calcolare meglio, e l’intero edificio trema. Un umanesimo più robusto dovrebbe legare la dignità a qualcosa che non è riducibile a performance… la responsabilità, la coscienza morale, la vulnerabilità, la capacità di prendersi cura, di rispondere dell’altro, di costruire significati condivisi.

Questo non significa che l’AI non conti. Significa il contrario, conta così tanto da costringerci a chiarire che cosa intendiamo per “umano”. E qui entra un elemento inquietante, l’AI non è solo uno strumento che facciamo usare alle persone, è anche un linguaggio che finisce per usarci. Se un sistema di raccomandazione decide che cosa vediamo, in quale ordine, con quali incentivi emotivi, allora modella la nostra attenzione. Se un assistente di scrittura suggerisce frasi “più efficaci”, allora plasma stili, toni, persino le forme di persuasione. Se un modello addestrato su testi passati diventa un filtro per produrre testi futuri, rischiamo un effetto di retroazione dove la cultura si richiude su ciò che è già stato statisticamente più rilevante.

Come sappiamo ciò che sappiamo? In un mondo mediato da sistemi automatici, il “sapere” non è solo una questione di verità, ma di affidamento. L’AI rende evidente che la conoscenza è anche istituzionale. Dipende da pratiche di controllo, da ruoli, da incentivi. Un modello può generare un testo perfetto e tuttavia alimentare una decisione ingiusta se viene inserito in un processo senza contrappesi.

Etica dentro il design

Una delle illusioni più pericolose è credere che “aggiungere l’etica” sia un passaggio accessorio. In realtà l’etica è dentro il design e dentro l’uso. È nelle metriche che scegliamo (accuratezza per chi? errore per chi? efficienza rispetto a che cosa?), è nei dataset (chi è rappresentato, chi è escluso), è nelle interfacce (quanto è facile raggiungere o contestare un risultato). L’AI ci obbliga a reimparare un concetto banale e sempre dimenticato: la responsabilità non si elimina con l’automazione. La legge non ammette: “lo ha detto il sistema”, “è l’algoritmo”, “è la policy”. Sembra tutto scontato vero? Vi assicuro che no lo è… anzi è uno degli argomenti che devo affrontare ad ogni workshop in cui sono relatore.

Vogliamo sistemi utili e al tempo stesso controllabili. Vogliamo supporto e al tempo stesso autonomia umana. Vogliamo efficienza e al tempo stesso equità. La governance dell’AI non è solo informatica ma strategia (se vogliamo usare un termine un poco freddo) e etica (se preferiamo una tonalità umanistica). Quale potere concediamo alle macchine e a chi le controlla? Con quali limiti? Con quali diritti di ricorso?

C’è però un modo di leggere tutto questo senza finire né nel panico né nella celebrazione. Possiamo interpretare l’AI come una prova di maturità culturale. Vogliamo che la creatività diventi una merce iper-prodotta e indistinta, o vogliamo preservare spazi in cui l’imperfezione umana (quella che spesso porta sorpresa) rimanga centrale? Sono domande che non si risolvono con una definizione tecnica, e nemmeno con una risposta unica. Si risolvono con sperimentazione regolata e con cultura critica.

Chiudiamo il cerchio

E qui si chiude il cerchio con l’immagine della lettera. La carta e l’inchiostro contano, certo. Ma la lettera è un atto, un legame, una promessa. Così l’AI è fatta di algoritmi, dati e statistiche che sono la materia. Ma ciò che ci riguarda davvero è la forma di vita che costruiamo attorno a quella materia. La frase “è solo statistica” può essere un buon punto di partenza, se serve a ricordarci che non c’è magia. Diventa una cattiva frase quando pretende di essere un punto di arrivo, perché allora ci lascia disarmati proprio davanti alla parte più difficile, quando dobbiamo scegliere, collettivamente, che cosa vogliamo diventare mentre costruiamo strumenti sempre più capaci.

Spero di non essere stato troppo noioso per i miei lettori più nerd… se ogni tanto ti piace vedere oltre la semplice tecnica restiamo in contatto su linkedin a: https://www.linkedin.com/in/andreatonin/

#feritaSimbolica #statistica #riduzionismo #antropologia #responsabilità #potere #governance #epistemologia #lavoro #dignità

Nerd per passione e per professione da oltre 30 anni, lavoro nel mondo dell’innovazione tecnologica come CTO e consulente, progettando ecosistemi software complessi e scalabili. Parallelamente mi dedico alla formazione informatica, condividendo esperienze e buone pratiche maturate sul campo.

Scopri di più sulla mia attività di consulenza su lucedigitale.com Mi trovi anche su LinkedIn