Se negli ultimi mesi ti è capitato di vedere clip “troppo belle per essere vere” nate da un semplice prompt, non è solo merito di Sora o dei modelli di Google. Kling AI (sviluppata da Kuaishou) è diventata una delle piattaforme più citate quando si parla di generazione video controllabile, non tanto “premi un bottone e incrocia le dita”, quanto “scrivi, imposta, guida”. Non è un dettaglio, perché il video generato da AI (a differenza di un’immagine) mette subito alla prova coerenza, continuità, movimento e intenzione narrativa.

Kling nasce come modello text-to-video e image-to-video, cioè può partire da una descrizione in linguaggio naturale oppure da un’immagine di riferimento e trasformarla in una clip animata. Nelle comunicazioni ufficiali di Kuaishou, l’idea è chiaramente quella di offrire un generatore capace di riprodurre movimento complesso e dinamiche fisiche credibili, con output di qualità “da contenuto reale”.

Per un lettore non tecnico, può sembrare la stessa promessa di tanti competitor. La differenza emerge quando inizi a usarla come la userebbe qualcuno che ragiona “a scene”, vuoi che il soggetto entri in campo, che la camera faccia un movimento preciso, che l’azione accada in un ordine e che l’inquadratura non tradisca ciò che hai scritto. Qui Kling si è guadagnata la reputazione di tool più “direzionabile”, soprattutto in certe versioni e modalità pensate per la cinematografia (nelle stesse note di Kuaishou si parla di funzioni premium legate a “professional cinematography support” e, cosa ancora più pratica, controlli come riferimenti di fine clip e modalità ad alte prestazioni).

Questo è anche il punto in cui si capisce perché, nel confronto che molti fanno “a pelle” con Veo di Google, Kling viene spesso descritta come più adatta a scene precise, storyboard e sequenze narrative. Veo (di Google DeepMind) è impressionante, e nelle versioni recenti mette in evidenza grandi passi in realismo, aderenza al prompt e controllo creativo (oltre alla spinta sull’integrazione in prodotti come Gemini/Flow e, nelle release più nuove, anche audio nativo). Ma l’esperienza d’uso e il “workflow mentale” non coincidono sempre, con alcuni strumenti ti senti più vicino a un generatore “one-shot”, con altri più vicino a un pannello di regia. Nel racconto di molti creator, Kling sta dalla parte dei secondi: più parametri, più leve, più possibilità di guidare la scena invece di sperare che l’AI “capisca l’atmosfera”.

Detto questo, non è il caso di avviare l’ennesima gara su “quale modello AI è il migliore”, in questo momento gli strumenti stanno evolvendo così in fretta che ciò che vale oggi può cambiare già la settimana prossima.

Tornando alla parte creativa, vale la pena dire una cosa: “più controllo” non significa “più facile”. Significa che hai più responsabilità. Se vuoi davvero usare Kling come strumento di regia, devi imparare a scrivere prompt come se fossero mini indicazioni di scena, e devi accettare l’iterazione. Fai una prima clip, aggiusti, rigeneri, rifinisci. In cambio ottieni qualcosa di raro nel mondo text-to-video: la sensazione di non essere solo spettatore del risultato, ma di averlo guidato. Ed è proprio questa la differenza che, oggi, fa uscire Kling dal mucchio dei “generatori” e la avvicina a un’idea di produzione.

Di seguito entriamo nel merito, partendo dalla documentazione ufficiale vedremo come funziona il prompt engineering in Kling e quali strumenti mette davvero a disposizione. L’idea è farne un punto di riferimento pratico per mettere un po’ d’ordine tra funzioni, workflow e possibilità di questo software davvero notevole. Da qui in avanti andiamo sul pratico e vediamo quali strumenti mette sul tavolo Kling e come cambia il modo di progettare una scena.

AI Video Generator

Text to Video

Parti da un prompt testuale e Kling genera una clip video da zero. È la modalità “scrivi la scena”, descrivi soggetto, ambiente, azione e (se vuoi) anche stile e movimenti di camera, e il modello prova a tradurli in video.

Image to Video

Parti da un’immagine (un frame, un concept, una foto, un personaggio) e Kling la anima, creando movimento e continuità. È utile quando vuoi mantenere un look preciso o “bloccare” l’identità visiva di un soggetto e poi farlo vivere in clip.

Motion Control

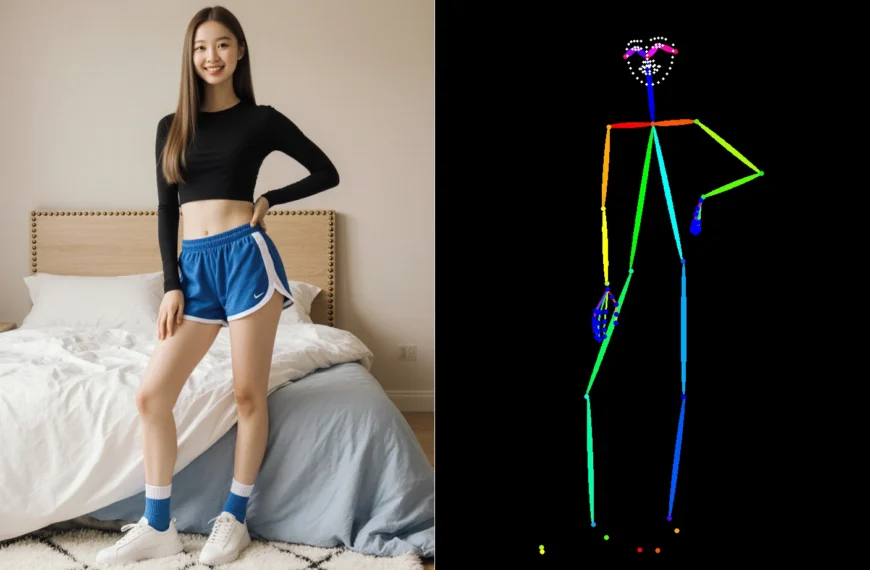

È il set di controlli che serve a guidare il movimento invece di lasciarlo al caso. Kling leggerà il movimento da una clip di riferimento per poi elaborare il risultato finale.

Elements

Sono “ingredienti” separati che puoi definire e richiamare in modo coerente, ad esempio un personaggio, un oggetto, un luogo o uno stile. L’idea è rendere più stabile il risultato tra clip diverse, evitando che ogni generazione “reinventi” tutto.

Multi-Elements

Invece di lavorare con un solo elemento alla volta, combini più elementi nello stesso progetto o nella stessa scena (per esempio personaggio + outfit + prop + location), così puoi costruire situazioni più complesse mantenendo coerenza e controllo.

PROMPT PER COMBINARE ELEMENTI E IMMAGINI

Meglio indicare con riferimenti precisi le immagini caricate e come usarle

Anima [Elemento_personaggio] come soggetto principale, mantenendo identità e outfit coerenti. Ambientazione presa da @immagine_location_neon: strada bagnata di notte, riflessi neon, pioggia leggera. Il personaggio alza lentamente lo sguardo verso camera e fa un mezzo passo avanti. Un piccolo drone pieghevole nero con luci blu entra da destra, si ferma sospeso accanto alla spalla e le luci pulsano due volte. Camera: slow push-in con micro-rotazione a sinistra negli ultimi secondi. Stile realistico cinematografico, contrasto morbido, grana leggera. Movimento naturale, senza deformazioni, senza cambi di volto, senza cambi di outfit

La [Elemento_personaggio] indossa @immagine_outfit mentre tiene tra le braccia @immagine_cucciolo

Aggiungi il gatto di @immagine_gatto al @video_paesaggio_montano

Rimuovi le persone che passeggiano nel fondale del video @video_piazza_san_marco

Modifica la statua del @video_leone_san_marco in un drago

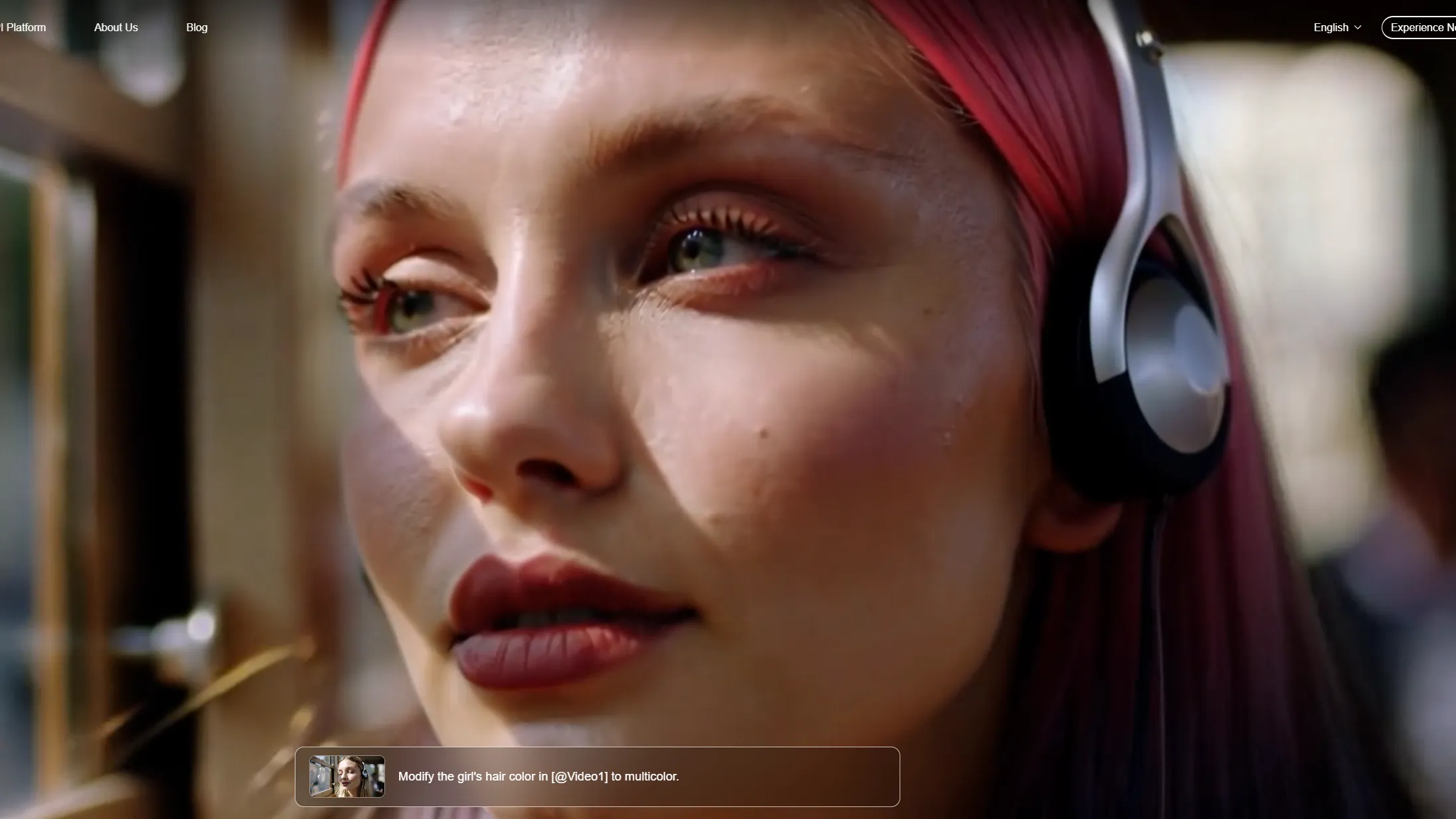

Modifica il colore dei capelli della ragazza nel @video_ragazza in rosa

Genera un angolo di ripresa differente per il @video_ripresa

Genera un medium-shot (oppure close-up etc...) del video @video_ripresa

Cambia il fondale del video @video_ripresa in... [PERFETTO CON RIPRESA IN GREEN SCREEN]

Cambia il tempo atmosferico del @video_ripresa in una giornata di pioggia [OTTIMO PER POST PRODUZIONE E VFX]

Cambia lo stile di @video_ripresa in pixel-artElements VS Images

In Kling “Image” e “Element” sembrano simili perché in entrambi i casi stai dando materiale visivo al modello (lo richiami con @), ma lo scopo è diverso.

Quando usi Image (Image-to-Video), di solito stai dando un’immagine di partenza (o una reference singola) che Kling deve “mettere in movimento”. È come dire: “parti da questo frame e animamelo”. Funziona benissimo per dare un look iniziale, un volto, un’inquadratura, ma col tempo può esserci più drift (piccole variazioni) perché quella reference non è pensata come “scheda identitaria” completa.

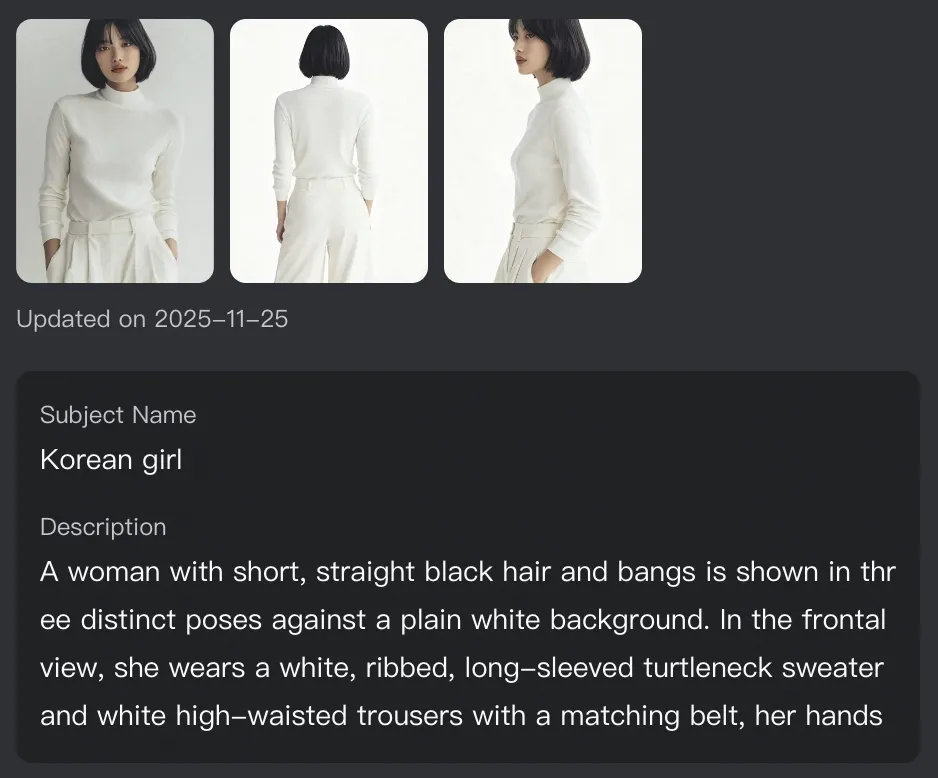

Un Element, invece, è pensato proprio come pacchetto di riferimento stabile: non è solo “un’immagine”, ma un soggetto (o oggetto, o scena) che vuoi resti coerente mentre la camera cambia, l’azione prosegue e magari entrano altri elementi. Nella comunicazione ufficiale sulla funzione “multi-image reference” (arrivata con Kling 1.6) l’idea è esplicita: puoi caricare una o più immagini dello stesso soggetto (o anche soggetti diversi) e Kling le usa per mantenere consistenza visiva e per gestire interazioni descritte a testo. In altre parole, l’Element è più vicino a una “reference bible” che a un singolo frame. In pratica saranno delle reference visive che rappresentano un personaggio o un oggetto da più angolazione, per permettere al modello di craerne la consistenza.

Qui sotto un Element completo di prompt descrittivo

Una buona scorciatoia mentale è questa: Image = punto di partenza da animare, Element = identità/asset da dirigere dentro la scena.

Nota pratica: la sintassi @ può essere usata in UI diverse per richiamare sia immagini sia elementi, ma concettualmente ciò che cambia è il “ruolo” dell’asset, animare un frame vs ancorare un soggetto/oggetto/scena per tenerlo consistente lungo la generazione.

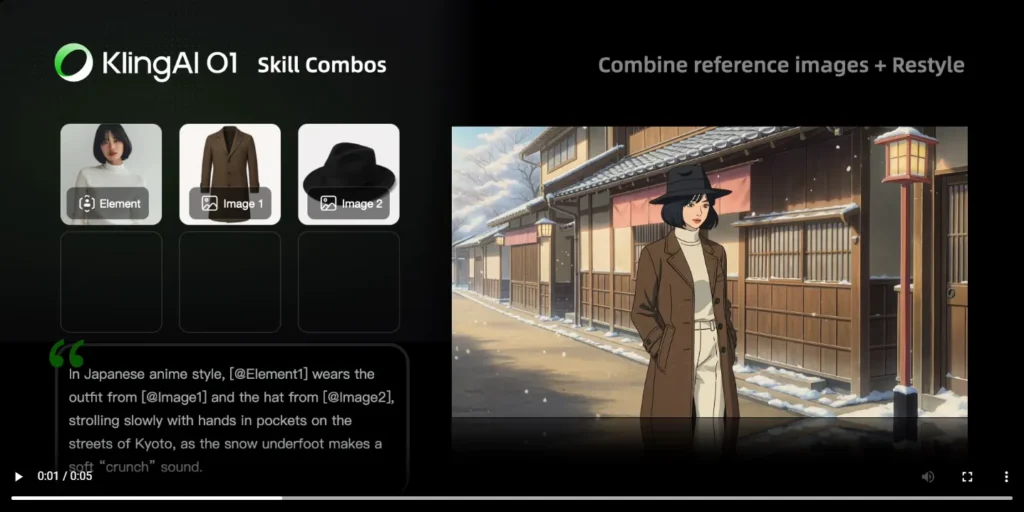

Skill Combos

In Kling puoi combinare Elements e Images in un task singolo.

Avatar

In Kling la voce “Avatar” di solito copre due momenti diversi dello stesso flusso, prima crei “chi” deve parlare, poi gli fai “dire” qualcosa in modo credibile.

Build Avatar è la parte in cui costruisci l’avatar (il “digital human”) partendo da una o più immagini (o, in alcune modalità, anche da reference aggiuntive). Qui l’obiettivo non è ancora parlare, ma fissare l’identità con volto, stile, resa visiva e una base di espressività/movimento coerente, così da poter riusare lo stesso personaggio in più clip senza che “cambi faccia” a ogni generazione. Nella letteratura tecnica legata a Avatar si insiste proprio su identity preservation e coerenza temporale nei video più lunghi.

Lip Sync è invece lo strumento che sincronizza la bocca (e spesso micro-espressioni del viso) con un audio parlato o con una traccia generata via text-to-speech. In pratica carichi (o selezioni) il video/avatar e dai in pasto la voce, e Kling anima labbra e fonemi per far combaciare il parlato con i movimenti, utile per doppiaggi, video “talking head”, tutorial e contenuti social.

Opzionale possiamo aggiungere anche un prompt al fine di controllare meglio la recitazione del nostro avatar.

#Spiegazione chiara, tono da divulgatore

“Recitazione naturale e rassicurante. Parla con ritmo medio, articolando bene, con micro-sorrisi quando introduci un concetto e una breve pausa prima dei punti chiave. Sguardo in camera quasi costante, piccoli cenni con la testa per confermare. Blink naturale, niente gesti ampi, energia controllata.”

#Entusiasmo ‘nerd’ (wow controllato, non teatrale)

“Tono curioso ed entusiasta ma credibile. Aumenta leggermente l’energia sulle parole importanti, sopracciglia più attive, sorriso breve quando citi una feature ‘wow’. Inserisci due pause corte dopo frasi decisive. Piccoli movimenti delle spalle e della testa, come quando spieghi a un amico qualcosa di interessante.”

#Serio e tecnico (stile “briefing”)

“Recitazione sobria, professionale. Ritmo leggermente più lento, tono fermo e neutro. Quasi nessun sorriso. Sguardo stabile in camera, testa ferma con micro-movimenti minimi. Pausa di mezzo secondo tra i paragrafi/idee. Niente gesticolazione, espressione concentrata.”

#Storytelling (introduzione con tensione leggera, poi sollievo)

“Parti con tono più basso e un filo di sospensione, come se stessi preparando un colpo di scena. Fai una pausa breve dopo la prima frase. Poi passa a un tono più luminoso e rassicurante quando dai la soluzione. Alterna sguardo in camera e piccoli sguardi laterali nei momenti ‘riflessivi’. Sorriso finale leggero, naturale.”

#Call to action morbida (persuasivo senza aggressività)

“Tono amichevole e convincente. Ritmo medio-veloce ma chiaro. Sorriso leggero e costante. Quando inviti a provare/approfondire, inclina appena la testa e fai una micro-pausa prima della frase finale. Gesti minimi, ma aggiungi un piccolo cenno con la mano (se visibile) nel punto di invito.”Effects

Una raccolta di effetti visivi pronti per un uso immediato.

AI Sound Effects Generator

Link AI Sound Effects Generator

Nel “Sound Effects Generator” invece di cercare su librerie audio, chiedi all’AI di creare suoni originali su misura, o partendo da una descrizione o da un video.

Text to Audio significa che generi solo audio da un prompt testuale ad esempio effetti sonori, ambience (pioggia, traffico, vento), piccoli foley (passi, fruscii, oggetti) e, a seconda della modalità, anche layer più “musicali”. In pratica scrivi “stivali che camminano su foglie secche” e ottieni alcune varianti tra cui scegliere, pronte da esportare e montare.

Video to Audio invece parte dal video (anche muto) e crea una traccia audio sincronizzata con ciò che succede in scena, ad esempio impatti quando qualcosa tocca terra, fruscii quando un tessuto si muove, rumore ambiente coerente con il luogo, spesso con timing legato al movimento sullo schermo. Puoi anche aggiungere un prompt per guidare stile ed emozione (più “cinematico”, più “realistico”, più “horror”, ecc.).

#City rain, realistico

Sound: “Pioggia leggera costante, traffico lontano, schizzi quando i passi toccano le pozzanghere, un paio di clacson ovattati. Sincronizza gli splash con i passi e i movimenti in scena.”

Music: “Ambient minimale, pad morbidi, tempo lento, molto discreta (quasi impercettibile).”

#Fight / action, impatti puliti

Sound: “Colpi e impatti realistici, fruscii dei vestiti durante i movimenti rapidi, passi su pavimento duro, chiusure/strisciate brevi. Metti i ‘hit’ esattamente sui contatti visivi, niente suoni cartoon.”

Music: “Pulse elettronico tensivo, basso leggero, crescendo breve nei momenti più intensi.”

#Cucina ASMR (perfetto anche con ASMR Mode)

Sound: “Foley ASMR ravvicinato: taglio su tagliere, fruscio carta/packaging, versata d’acqua, sfrigolio leggero in padella, posate e piatti delicati. Audio molto dettagliato, dinamica controllata, niente rumore di fondo.”

Music: “Nessuna musica (lascia vuoto).”

#Nature / hiking, atmosfera + dettagli

Sound: “Ambience di bosco: vento tra le foglie, uccelli lontani, passi su ghiaia/terra, piccoli rami che si spezzano quando il piede li calpesta. Sincronizza i passi con il camminare e aumenta i dettagli nei primi piani.”

Music: “Acustica leggera (chitarra/archi soffusi), tono contemplativo, molto bassa.”

#Sci-fi lab / neon, sound design ‘pulito’

Sound: “Laboratorio futuristico: ronzio elettrico basso continuo, beep UI e piccoli feedback sonori quando appaiono elementi a schermo, servo-motori morbidi, porte automatiche ‘whoosh’. Sincronizza beep e whoosh con le azioni visive, stile high-tech realistico.”

Music: “Synth cinematico freddo, note lunghe, senza ritmo marcato.”AI Virtual Try-On Generator

Link AI Virtual Try-On Generator

L’AI Virtual Try-On Generator è la parte “fashion” di Kling e serve a simulare come starebbe un capo su una persona, senza fare uno shooting e senza dover provare fisicamente nulla. Dentro ci sono due funzioni che sembrano simili, ma hanno scopi diversi.

Virtual Model è la modalità in cui crei (o selezioni) un modello virtuale su cui far “indossare” i capi. In pratica, invece di partire da una foto tua o di un cliente, parti da un manichino digitale: scegli il tipo di corporatura, il look generale e lo stile di presentazione, e poi ci appoggi sopra l’outfit. È utile per ecommerce e cataloghi perché ti permette di mostrare lo stesso capo su un modello coerente, con pose e resa pulita, senza dipendere da foto reali o da set diversi.

“Modello virtuale full-body, 25–30 anni, corporatura slim atletica, altezza 175 cm, posa neutra frontale con braccia leggermente distaccate dal corpo, espressione naturale. Studio lighting morbido, sfondo grigio chiaro uniforme, look fotorealistico, nessun accessorio, nessun testo o logo.”

“Modella virtuale full-body, 30–35 anni, corporatura curvy, altezza 168 cm, posa 3/4 con mano sul fianco, capelli raccolti, trucco leggero. Illuminazione da set e-commerce, sfondo bianco pulito, resa fotorealistica, dettagli pelle naturali, niente gioielli, niente cappelli.”

“Modello virtuale maschile full-body, 40–45 anni, corporatura media, altezza 182 cm, postura dritta, posa neutra tipo catalogo, mani lungo i fianchi. Luce uniforme senza ombre dure, sfondo beige neutro, fotorealistico, niente tatuaggi visibili, niente occhiali, niente accessori.”

“Modello virtuale gender-neutral full-body, 20–25 anni, corporatura longilinea, altezza 178 cm, posa ‘runway’ minimale (un piede leggermente avanti), sguardo in camera. Look editoriale ma pulito, luce da studio con contrasto morbido, sfondo grigio scuro uniforme, alta definizione, nessun elemento di scena.”

“Modello virtuale full-body, 28–35 anni, corporatura plus-size, altezza 170 cm, posa frontale neutra stile manichino (A-pose leggera), espressione calma. Illuminazione e-commerce molto uniforme, sfondo bianco, fotorealistico, niente piercing, niente gioielli, niente accessori, nessun testo o watermark.”AI Virtual Try-On invece è la modalità “prova su persona” dove carichi la foto di una persona (o un’immagine di riferimento) e il sistema prova a trasferire il capo su quel corpo mantenendo proporzioni, pieghe, vestibilità e (idealmente) l’identità della persona. Qui il valore è la personalizzazione, se ti interessa vedere come cade una giacca su quel fisico, come cambia la silhouette, come si comporta un tessuto con quella posa.

Kling Lab

KlingLab è, in pratica, la “scrivania” di Kling pensata per lavorare in modo più professionale rispetto alla classica pagina “genera video / genera immagini”. Invece di entrare in un tool alla volta, Kling Lab ti mette davanti a un canvas ampio (tipo lavagna infinita) dove puoi raccogliere idee, prompt, reference e risultati, collegandoli tra loro fino a costruire un flusso coerente (dalla bozza al pezzo quasi finito). Questo workspace è nato per rendere il processo creativo più scorrevole supportando anche la condivisione del progetto con il proprio team creativo.

Professional Workflow

Ecco un workflow “da studio” in cui Kling entra in modo pulito, senza spezzare il flusso tradizionale (e lasciando sempre spazio a correzioni manuali quando serve). Come suite di editing andiamo sullo standard di mercato, cioè Adobe. In alternativa potremo valutare una suite composta da software free, ad esempio Gimp+Inkscape+Blender.

PRE-PRODUZIONE

[Brainstorming (LLM)]

↓

[Script / scaletta (LLM)]

↓

[Storyboard (Text-to-Img) + Photoshop]

↓

[Animatic / timing (montaggio grezzo con placeholder)]

↓

PRODUZIONE

[Animazione 2D / Animazione 3D / Ripresa dal vivo]

↓

(export “plates” / shot base puliti)

↓

POST-PRODUZIONE IMMAGINE

[Kling AI – VFX / generative post]

- shot mancanti / alternative

- estensioni di inquadratura

- raccordi e transizioni “in stile”

- fix di piccoli problemi (background, continuità, ecc.)

↓

[Compositing / color / rifinitura tradizionale (se serve)]

↓

POST-PRODUZIONE AUDIO

[Kling AI – SFX]

- Video→Audio (foley sync)

- Text→Audio (effetti mirati)

[Musica (Suno)]

- cue / mood

- varianti

↓

[Mix / stem / loudness (necessario software DAW)]

↓

MONTAGGIO E DELIVERY

[Premiere: edit finale + export]Link ufficiali

- Manuale: https://app.klingai.com/global/quickstart

- YouTube: https://www.youtube.com/@Kling_ai

Se l’articolo ti è piaciuto restiamo in collegamento su linkedin a: https://www.linkedin.com/in/andreatonin/

Nerd per passione e per professione da oltre 30 anni, lavoro nel mondo dell’innovazione tecnologica come CTO e consulente, progettando ecosistemi software complessi e scalabili. Parallelamente mi dedico alla formazione informatica, condividendo esperienze e buone pratiche maturate sul campo.

Scopri di più sulla mia attività di consulenza su lucedigitale.com Mi trovi anche su LinkedIn